GPT-5, mô hình ngôn ngữ thế hệ tiếp theo của OpenAI, đang được kỳ vọng sẽ ra mắt vào mùa hè năm nay. Trong một podcast hồi tháng 6, CEO Sam Altman cho biết GPT-5 “có thể sẽ trình làng vào mùa hè”. Với lịch sử phát hành gần đây gồm GPT-4 (tháng 3/2023), GPT-4 Turbo (tháng 11/2023) và GPT-4o (tháng 5/2024), nhiều chuyên gia cho rằng thời điểm ra mắt GPT-5 đã rất gần.

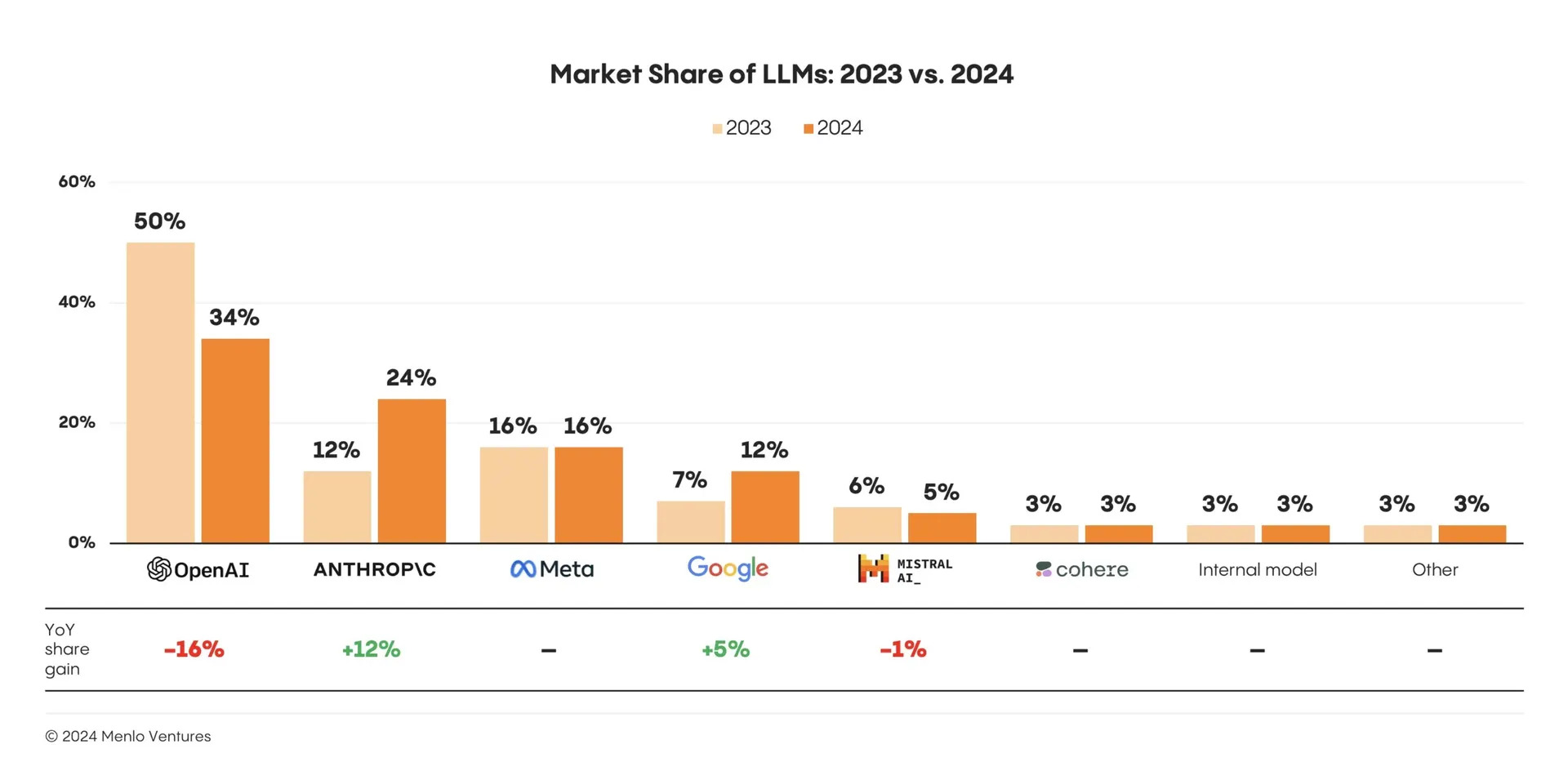

Tuy nhiên, khi OpenAI vẫn đang trong giai đoạn hoàn thiện, các đối thủ đã tăng tốc đáng kể. Meta chi hàng tỷ USD chỉ trong 10 ngày để chiêu mộ nhân sự từ OpenAI, làm dấy lên lo ngại về “chảy máu chất xám”. Theo Menlo Ventures, thị phần doanh nghiệp của OpenAI đã giảm từ 50% xuống còn 34%, trong khi Anthropic vươn lên mạnh mẽ từ 12% lên 24%. Google với Gemini 2.5 Pro đang dẫn đầu về khả năng toán học, DeepSeek R-1 được ví như một cuộc cách mạng, còn Grok của xAI đang ngày càng được cộng đồng lập trình viên đánh giá cao.

So sánh thị phần năm 2023-2024 của các mô hình ngôn ngữ lớn. Nguồn: Menlo Ventures

Theo chia sẻ từ vị CEO tài năng Altman, điểm đột phá lớn nhất của GPT-5 là khả năng hợp nhất toàn bộ hệ sinh thái AI đa phương thức của OpenAI (từ văn bản, hình ảnh, giọng nói đến video) vào một mô hình duy nhất. Người dùng sẽ không còn cần chuyển đổi giữa nhiều công cụ như hiện nay mà sẽ tương tác thông qua một hệ thống tích hợp liền mạch.

Một nâng cấp đáng chú ý khác là cửa sổ ngữ cảnh (context window) có thể đạt đến 2 triệu tokens, gấp gần 16 lần GPT-4o. Điều này cho phép GPT-5 duy trì mạch hội thoại dài hơn, hiểu rõ ngữ cảnh xuyên suốt và phản hồi một cách mạch lạc hơn bao giờ hết.

Ngoài ra, GPT-5 sẽ nâng cấp tính năng ghi nhớ cá nhân: nhớ tên người dùng, sở thích, phong cách trò chuyện và thậm chí các dự án đang thực hiện. Đây được xem là bước tiến giúp mô hình tiến gần hơn tới vai trò trợ lý kỹ thuật số thực thụ, thay vì chỉ là một chatbot phản ứng ngắn hạn.

Về mặt suy luận, GPT-5 được kỳ vọng sẽ ứng dụng cơ chế “tư duy chuỗi có cấu trúc” (structured chain-of-thought) – cho phép mô hình chia nhỏ vấn đề và giải quyết từng bước, gần hơn với cách tư duy logic của con người.

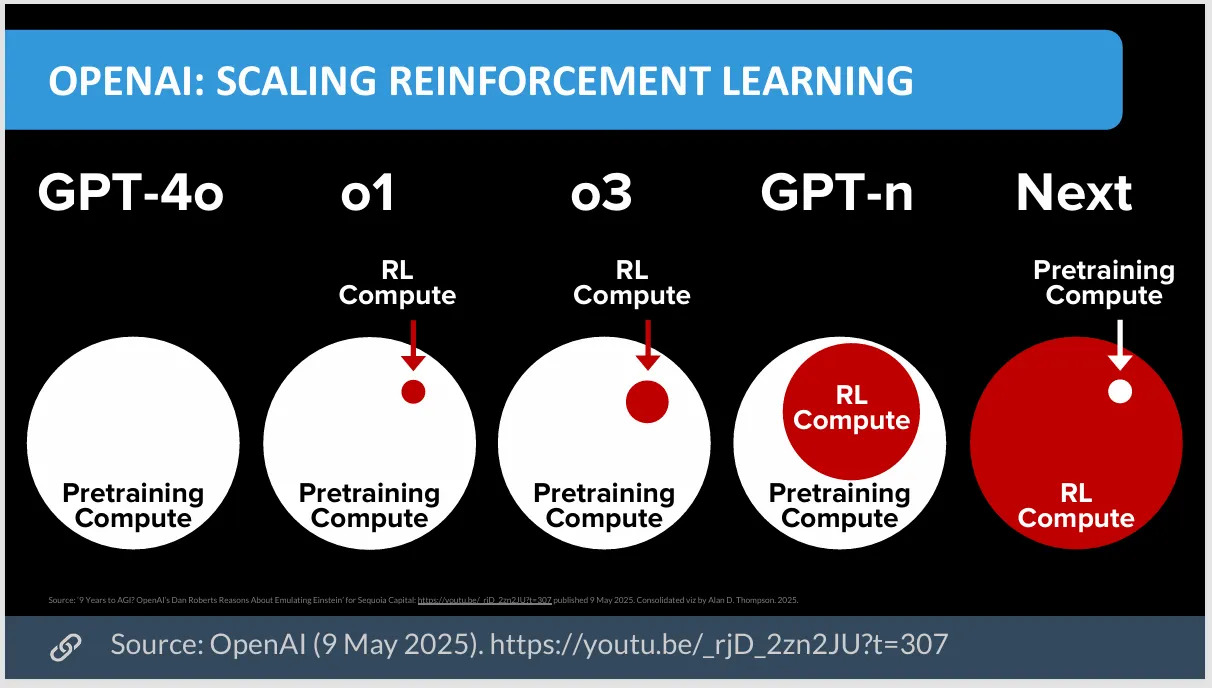

Mặc dù có nhiều đồn đoán về số lượng tham số của GPT-5 (từ 10 đến 50 nghìn tỷ, thậm chí lên tới một triệu tỷ), ông Altman cho rằng “kỷ nguyên mở rộng tham số đã kết thúc”. Thay vào đó, chất lượng dữ liệu huấn luyện và phương pháp học hiệu quả mới là yếu tố then chốt.

Một vấn đề đáng lo ngại là nguồn dữ liệu huấn luyện từ Internet đang dần cạn kiệt. Để giải quyết, OpenAI đang hướng tới dữ liệu tổng hợp (synthetic data) do AI tạo ra - đặc biệt trong các lĩnh vực có thể xác minh như toán học và lập trình - nhằm tạo ra dữ liệu chất lượng cao với tốc độ nhanh, giảm lệ thuộc vào nguồn dữ liệu truyền thống.

Quy mô máy học tăng cường của OpenAI. Nguồn: Sequoia Capital

Song, dù được kỳ vọng cao, nhiều chuyên gia khuyên người dùng nên giữ cái nhìn thận trọng. Wyatt Mayham, CEO của Northwest AI Consulting, cho rằng GPT-5 là “một bước tiến quan trọng, nhưng chưa phải một cuộc cách mạng”. Mỗi phiên bản mới có thể sửa lỗi cũ, nhưng cũng mang theo rủi ro và thách thức mới.

Tony Tong, CTO Intellectia AI, nhận định GPT-5 sẽ cải thiện đáng kể ở khả năng suy luận, kiểm soát hành vi và tích hợp công cụ, nhưng chưa chắc tạo nên đột phá tuyệt đối. Trong khi đó, Patrice Williams-Lindo, CEO Career Nomad, cho rằng chỉ riêng việc GPT-5 có tính ổn định cao, nhớ lâu và tỷ lệ lỗi thấp đã là một chiến thắng đáng giá, đặc biệt với người dùng cá nhân.

Hiện tại, GPT-5 có thể chưa đạt đến ngưỡng AGI (trí tuệ nhân tạo tổng quát), nhưng nếu đúng như kỳ vọng, mô hình này sẽ mang đến một trải nghiệm thống nhất, mượt mà, ghi nhớ dài hạn và tư duy gần với con người hơn. Trong bối cảnh thị trường AI ngày càng đông đúc và cạnh tranh gay gắt, đây vẫn là một cột mốc đáng để chờ đợi.

Trong khuôn khổ sự kiện GM Việt Nam, nơi hội tụ của các dự án Web3 nổi bật trong và ngoài nước, Loky, dự án có trụ sở tại Singapore, đã góp mặt như một đại diện tiêu biểu cho làn sóng kết hợp giữa AI và blockchain - hai công nghệ đang định hình tương lai số.